Meta AI đã tìm ra cách giúp AI có thể “học tiếp” mà không bị “mất trí nhớ”

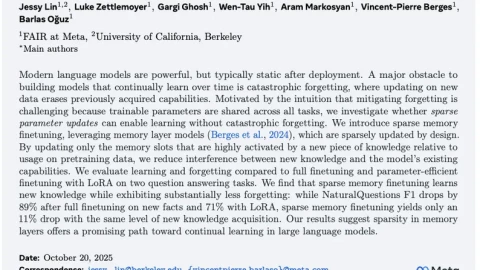

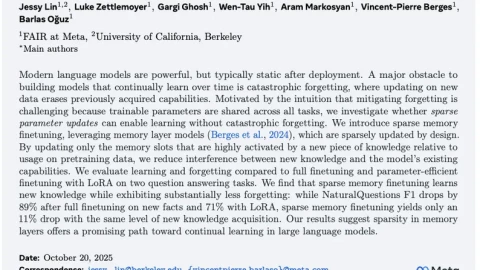

Một bài báo gần đây đang gây chú ý với cộng đồng AI khi Meta AI tuyên bố đạt được bước đột phá mới trong hành trình giúp các mô hình ngôn ngữ lớn (LLM) thực sự “học liên tục” thay vì bị đóng băng sau khi huấn luyện. Vấn đề lâu nay của giới AI là mỗi lần tinh chỉnh mô hình để học thêm kiến thức mới, nó lại đánh mất phần lớn kiến thức cũ. Đây là hiện tượng được gọi là “quên thảm khốc”. Các hướng tiếp cận trước đây như học theo ngữ cảnh (In-context...

Đọc bài gốc tại

đây

Đăng nhập một lần thảo luận tẹt ga

window.googletag = window.googletag || {cmd: []};

googletag.cmd.push(function() {

window.uk_delivery_1753154734465 = googletag.defineSlot('/57976558/Ureka_Supply_home.vn_Outstream_1x1_270225', [1,1], 'div-gpt-ad-1753154734465-0').addService(googletag.pubads());

googletag.pubads().enableSingleRequest();

googletag.enableServices();

googletag.display('div-gpt-ad-1753154734465-0');

});

googletag.cmd.push(function() {

if(googletag.pubads().isInitialLoadDisabled() && !window.uk_delivery_1753154734465.getResponseInformation()){

googletag.pubads().refresh([window.uk_delivery_1753154734465])

}

});

window.googletag = window.googletag || {cmd: []};

googletag.cmd.push(function() {

window.uk_delivery_1753685560510 = googletag.defineSlot('/57976558/Ureka_Supply_home.vn_InpageMB_1x1_110325', [1,1], 'div-gpt-ad-1753685560510-0').addService(googletag.pubads());

googletag.pubads().enableSingleRequest();

googletag.enableServices();

googletag.display('div-gpt-ad-1753685560510-0');

});

googletag.cmd.push(function() {

if(googletag.pubads().isInitialLoadDisabled() && !window.uk_delivery_1753685560510.getResponseInformation()){

googletag.pubads().refresh([window.uk_delivery_1753685560510])

}

});

Một bài báo gần đây đang gây chú ý với cộng đồng AI khi Meta AI tuyên bố đạt được bước đột phá mới trong hành trình giúp các mô hình ngôn ngữ lớn (LLM) thực sự “học liên tục” thay vì bị đóng băng sau khi huấn luyện. Vấn đề lâu nay của giới AI là mỗi lần tinh chỉnh mô hình để học thêm kiến thức mới, nó lại đánh mất phần lớn kiến thức cũ. Đây là hiện tượng được gọi là “quên thảm khốc”. Các hướng tiếp cận trước đây như học theo ngữ cảnh (In-context...

Một bài báo gần đây đang gây chú ý với cộng đồng AI khi Meta AI tuyên bố đạt được bước đột phá mới trong hành trình giúp các mô hình ngôn ngữ lớn (LLM) thực sự “học liên tục” thay vì bị đóng băng sau khi huấn luyện. Vấn đề lâu nay của giới AI là mỗi lần tinh chỉnh mô hình để học thêm kiến thức mới, nó lại đánh mất phần lớn kiến thức cũ. Đây là hiện tượng được gọi là “quên thảm khốc”. Các hướng tiếp cận trước đây như học theo ngữ cảnh (In-context...